Son raporlara göre, siber güvenlik uzmanları, deepfake telefon dolandırıcılıkları giderek yaygınlaştıkça ailelere “güvenli kelime” sistemi benimsemelerini tavsiye ediyor.

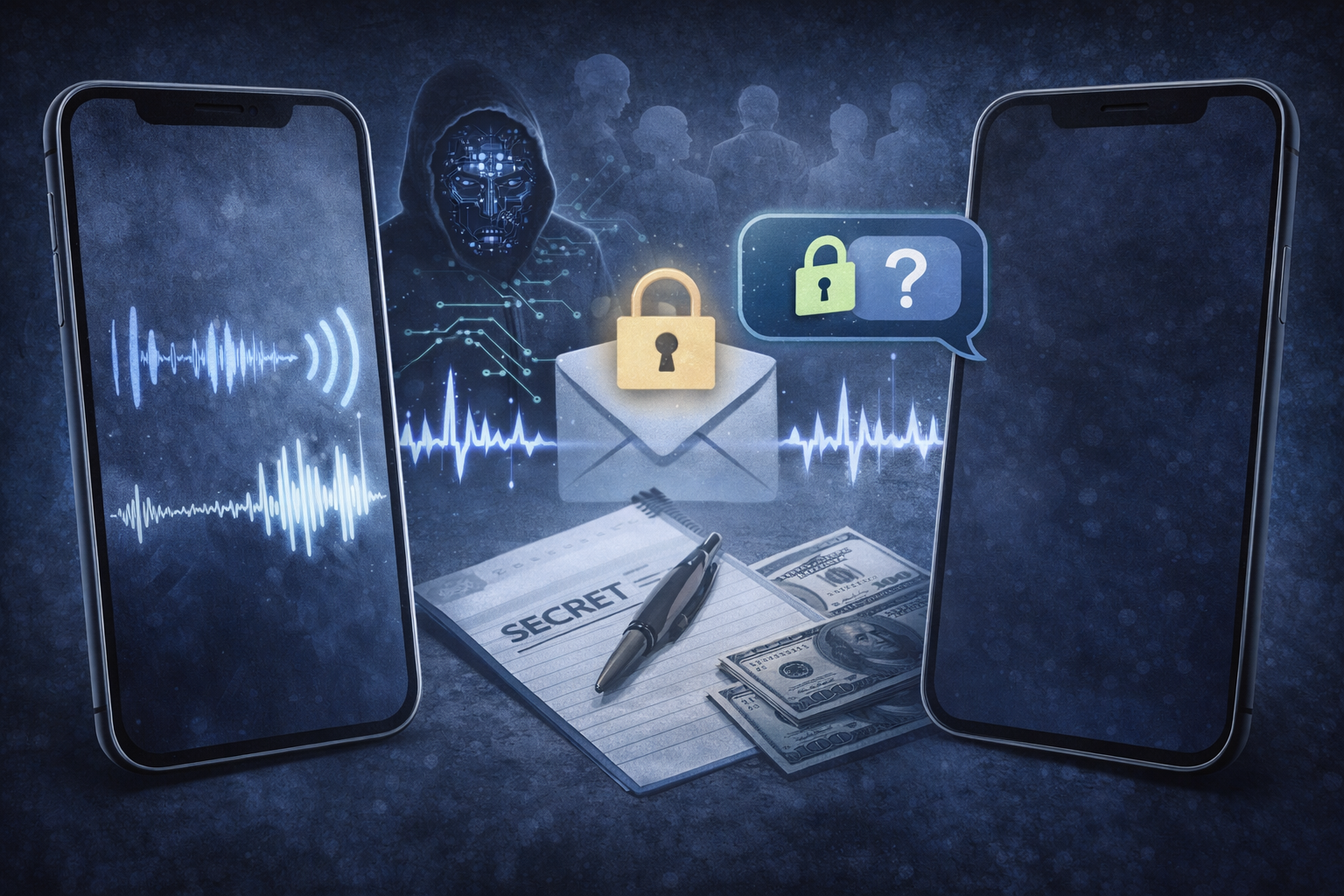

Tavsiye, her dört Amerikalıdan birinin geçen yıl içinde deepfake sesli görüşme aldığını bildirdiğini gösteren verilere dayanıyor. Bu aramalar, para veya hassas bilgi talep etmek için aile üyesi veya iş arkadaşı gibi güvenilir bir kişinin sesini taklit etmek için yapay zeka araçlarını kullanır.

Araştırmacılar, taklit dolandırıcılıklarının yıllardır var olduğunu, ancak yapay zeka tarafından oluşturulan ses klonlamanın etkinliğini artırdığını belirtiyor. Modern araçlar, sadece kısa ses örnekleri kullanarak bir kişinin sesini kopyalayabilir, bu da hedeflerin gerçek ve sahte aramaları ayırt etmesini zorlaştırır.

Önerilen koruma, yalnızca güvenilir kişilerin bildiği özel bir kelime veya ifade üzerinde anlaşmayı içerir. Şüpheli bir arama sırasında, alıcı arayanın kimliğini doğrulamak için güvenli kelimeyi talep edebilir. Arayan kişi bunu sağlayamıyorsa, uzmanlar konuşmayı sonlandırmayı ve kişiyle doğrudan bilinen bir numaradan iletişime geçmeyi önerir.

Uzmanlar, güvenli kelimelerin benzersiz olmasını ve kolayca tahmin edilemeyen ya da internette bulunmamasını önerir. İsimler, yerler veya tarihler gibi kamuya açık bilgilerden kaçınılmalıdır. Bazı durumlarda, güvenilirliği artırmak için daha uzun ifadeler veya birden fazla doğrulama adımı kullanılabilir.

Rehberlik, yapay zekanın sosyal mühendislik saldırılarında kullanımıyla ilgili daha geniş endişeleri yansıtıyor. Deepfake teknolojisi, yöneticilerin ve aile üyelerinin kimliğini taklit etmek gibi dolandırıcılık planlarında giderek daha fazla kullanılmaya başlandı; amacı acil durum yaratmak ve anında finansal transferleri teşvik etmektir.

Yetkililer ve araştırmacılar, teknik tespit araçları geliştirilirken, güvenli kelimeler gibi basit doğrulama yöntemlerinin bireyler ve aileler için pratik bir önlem olarak kaldığını belirtiyor.