Cybersecurity-experts adviseren gezinnen een “safeword”-systeem te gebruiken nu deepfake-telefoonfraude steeds vaker voorkomen, volgens recente berichten.

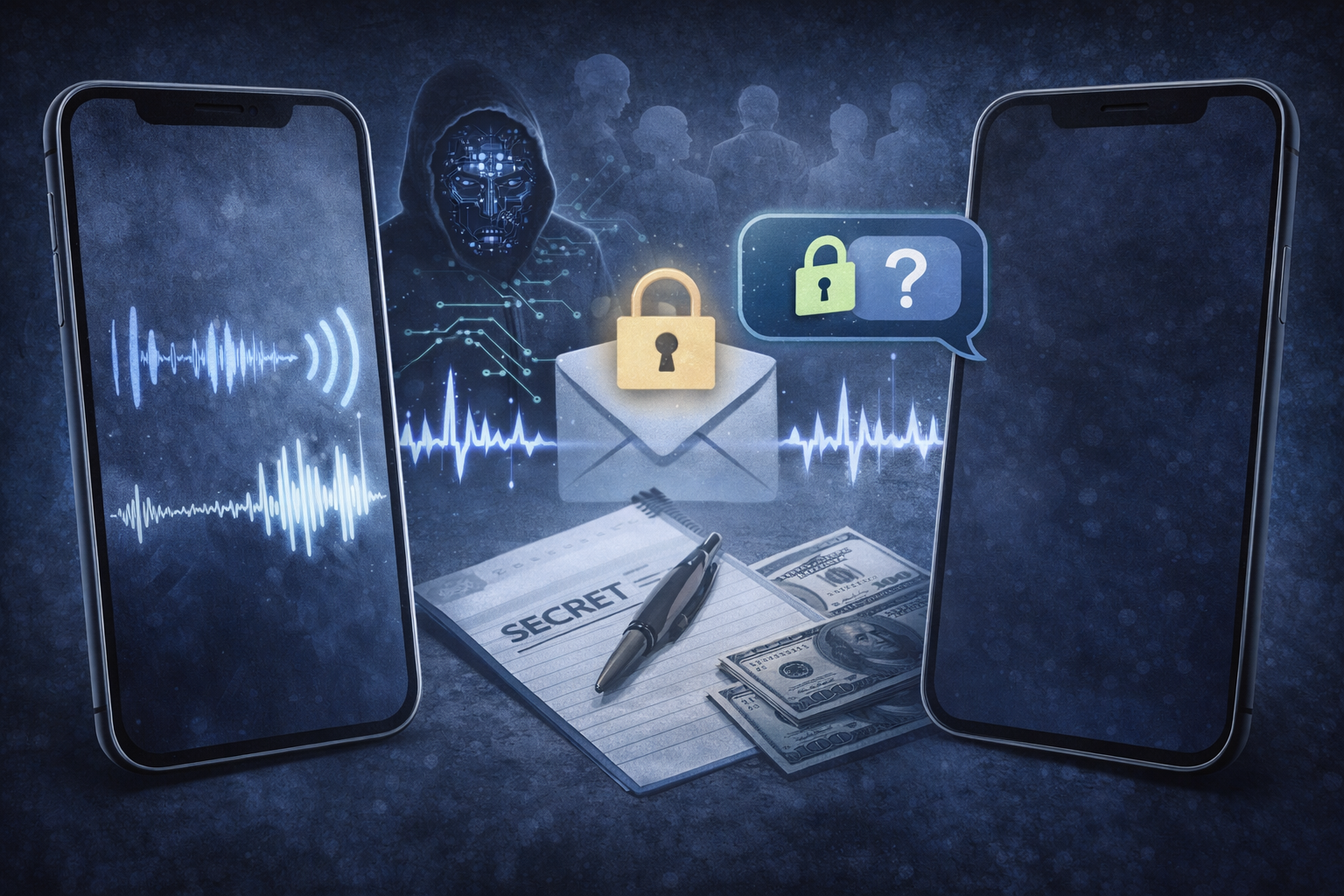

De aanbeveling volgt op gegevens waaruit blijkt dat één op de vier Amerikanen het afgelopen jaar een deepfake voice-oproep heeft ontvangen. Deze gesprekken maken gebruik van kunstmatige intelligentie-tools om de stem van een vertrouwd persoon, zoals een familielid of collega, na te bootsen om geld of gevoelige informatie op te vragen.

Onderzoekers stellen dat imitatiefraudes al jaren bestaan, maar dat AI-gegenereerde stemklonering hun effectiviteit heeft verhoogd. Moderne tools kunnen de stem van een persoon nabootsen met slechts korte audiosamples, waardoor het voor doelwitten moeilijker wordt om echte en frauduleuze gesprekken te onderscheiden.

De voorgestelde bescherming houdt in dat men akkoord gaat met een privéwoord of uitdrukking die alleen bekend is bij vertrouwde personen. Tijdens een verdachte oproep kan de ontvanger het safeword opvragen om de identiteit van de beller te verifiëren. Als de beller deze niet kan leveren, adviseren experts het gesprek te beëindigen en de persoon rechtstreeks te benaderen via een bekend nummer.

Experts raden aan dat veilige woorden uniek zijn en niet gemakkelijk te raden of online te vinden. Openbaar beschikbare informatie, zoals namen, locaties of data, moet worden vermeden. In sommige gevallen kunnen langere termijnen of meerdere verificatiestappen worden gebruikt om de betrouwbaarheid te vergroten.

De richtlijn weerspiegelt bredere zorgen over het gebruik van AI bij social engineering-aanvallen. Deepfake-technologie wordt steeds vaker gebruikt in fraudepraktijken, waaronder het nadoen van leidinggevenden en familieleden, met als doel urgentie te creëren en directe financiële overboekingen te stimuleren.

Autoriteiten en onderzoekers stellen dat hoewel technische detectietools worden ontwikkeld, eenvoudige verificatiemethoden zoals veilige woorden nog steeds een praktische maatregel zijn voor individuen en gezinnen.