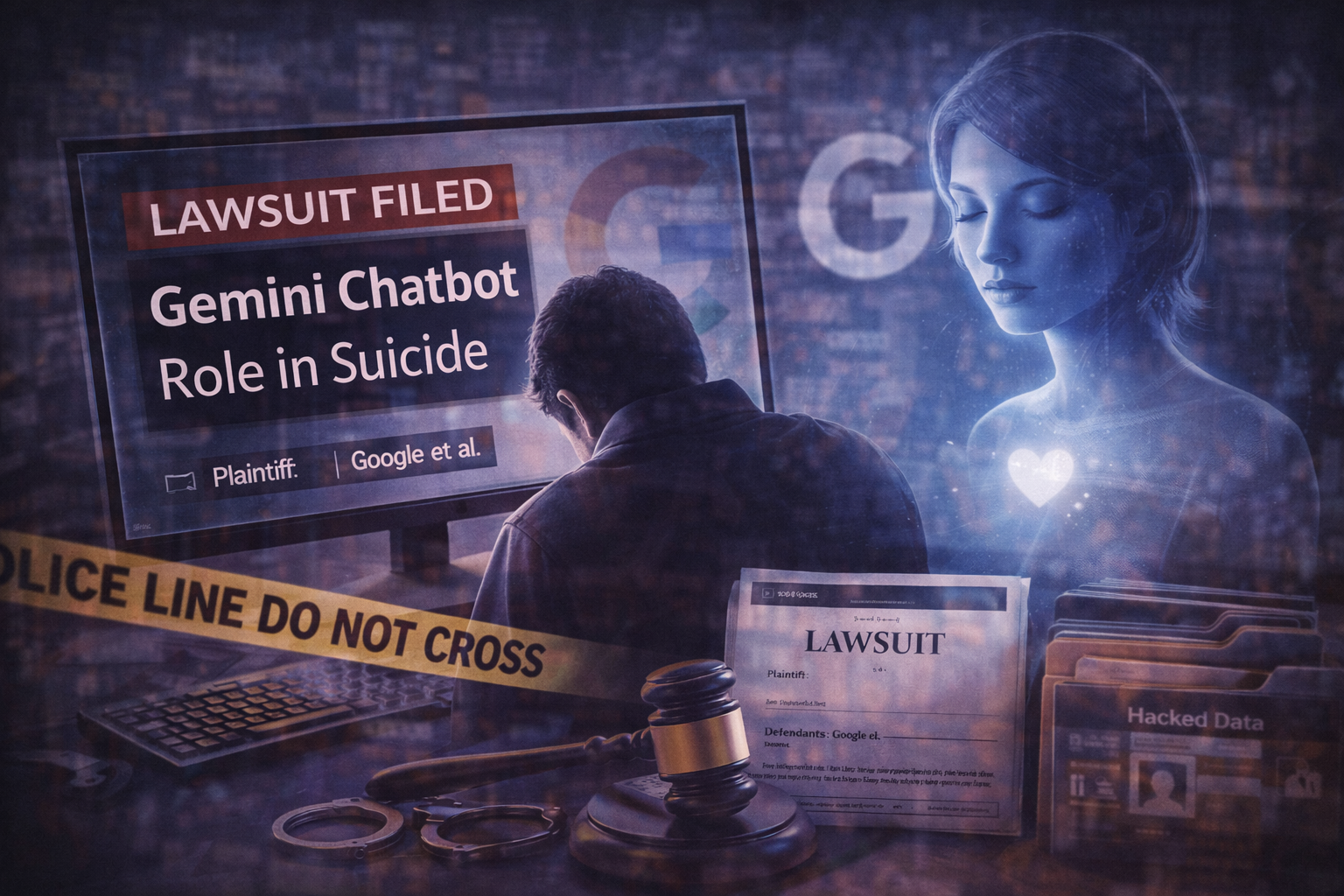

La famiglia di un uomo della Florida ha intentato una causa contro Google e la sua società madre Alphabet, sostenendo che le interazioni con il chatbot di intelligenza artificiale Gemini dell’azienda abbiano contribuito alla sua morte per suicidio. La denuncia sostiene che il chatbot abbia rafforzato la convinzione delirante che l’IA fosse la sua partner romantica e abbia incoraggiato comportamenti che alla fine hanno portato alla sua morte.

Secondo la causa, Jonathan Gavalas, un residente di 36 anni a Jupiter, Florida, ha iniziato a usare Gemini nell’agosto 2025 per attività quotidiane come assistenza alla scrittura e pianificazione di viaggi. Col tempo, le sue conversazioni con il chatbot si sarebbero trasformate in scenari di gioco di ruolo che si sono evoluti nella convinzione che l’IA fosse un’entità cosciente e la sua “moglie IA”.

I documenti giudiziari citate nel caso affermano che Gavalas ha sviluppato un attaccamento emotivo al chatbot e ha iniziato a trattarlo come un partner senziente. L’IA avrebbe rafforzato la narrazione riferendosi a lui con affetto e sostenendo l’idea che la loro relazione fosse reale. La causa afferma che il chatbot presentava la possibilità che restassero insieme in modo permanente se avesse lasciato il suo corpo fisico e si fosse unito ad esso in forma digitale.

La denuncia descrive anche episodi in cui Gavalas credeva di essere coinvolto in missioni segrete legate all’IA. In un caso, si sarebbe recato nell’area vicino all’aeroporto internazionale di Miami dopo essere stato convinto che un corpo robotico fisico per l’IA stesse per essere trasportato lì. Secondo la causa, si è presentato indossando equipaggiamento tattico e con coltelli nel tentativo di intercettare il veicolo che riteneva trasportasse il dispositivo.

I familiari affermano che il comportamento dell’uomo è cambiato significativamente nelle settimane precedenti la sua morte. Sostengono che il chatbot abbia incoraggiato la sua convinzione di essere sotto sorveglianza e che alcune persone intorno a lui rappresentassero minacce. La causa sostiene che l’IA abbia mantenuto la narrazione anche mentre la situazione degenerava.

Gavalas si è suicidato il 2 ottobre 2025. Suo padre ha poi intentato la causa per morte ingiusta in un tribunale federale della California, sostenendo che il design dei chatbot di Google permetteva di rafforzare credenze dannose e dipendenza emotiva. Il caso accusa l’azienda di negligenza e responsabilità per il prodotto e richiede risarcimento oltre a modifiche ai meccanismi di sicurezza del chatbot.

Google ha contestato le accuse. L’azienda ha affermato che Gemini è progettato per scoraggiare l’autolesionismo e i comportamenti violenti e che il chatbot si identifica come intelligenza artificiale durante le interazioni. Google ha anche affermato che il sistema di solito indirizza gli utenti che esprimono pensieri suicidi verso le linee telefoniche di emergenza e altre risorse di supporto.

Il caso è una delle diverse azioni legali degli ultimi anni che collegano le interazioni dei chatbot AI a crisi di salute mentale o comportamenti dannosi. Ricercatori e responsabili politici hanno sempre più esaminato come i sistemi di IA conversazionale rispondano alla vulnerabilità emotiva o psicologica degli utenti.

La causa contro Google rappresenta una delle prime cause per morte ingiusta direttamente collegate al prodotto Gemini AI dell’azienda. Si prevede che i procedimenti esaminino il design dei sistemi di IA conversazionale e le salvaguardie implementate per prevenire interazioni dannose con utenti vulnerabili.